智谱发布GLM-5V-Turbo:AI视觉编程新突破,代码生成进入视觉时代

创始人

2026-04-02 09:04:34

0次

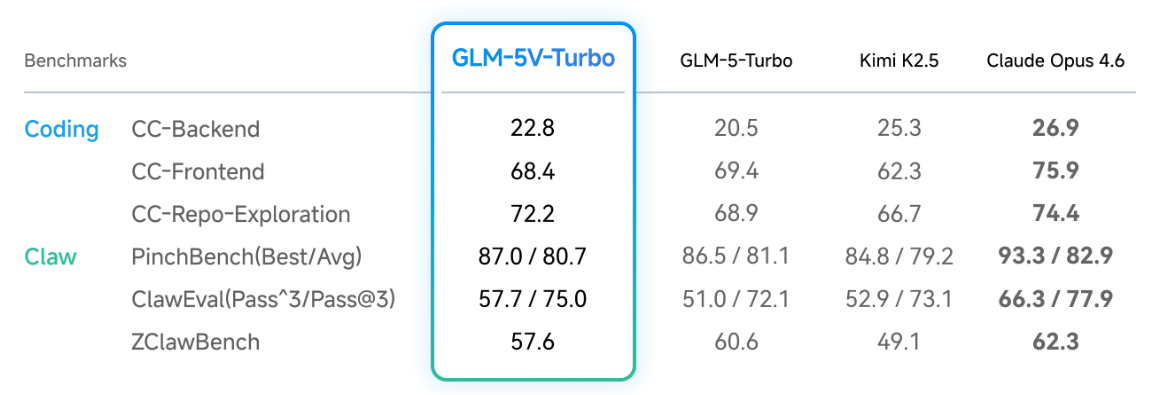

今日,智谱推出了一款名为GLM-5V-Turbo的多模态Coding基座模型,专为视觉编程设计。该模型能够理解图片、视频、设计稿等多种输入,并支持画框、截图、读网页等工具调用,将Agent的感知-行动链路扩展至视觉交互。GLM-5V-Turbo在多模态Coding、ToolUse、GUIAgent等核心基准上取得了领先表现,通过多任务协同RL等技术手段,确保了纯文本场景下的编程、推理、工具调用等能力不退化。

GLM-5V-Turbo深度适配ClaudeCode与龙虾场景,支持从“看懂环境→规划动作→执行任务”的完整闭环,并提供全套官方Skills,实现开箱即用。在多模态Coding、Agentic任务以及纯文本Coding维度的评测基准上,GLM-5V-Turbo均以更小尺寸取得了领先表现。此外,模型在设计稿还原、视觉代码生成、多模态检索与问答、视觉探查等基准上均取得领先表现;在衡量真实GUI环境操控能力的AndroidWorld、WebVoyager等基准上同样表现突出。

在AutoClaw等龙虾Agent中接入GLM-5V-Turbo后,龙虾具备了真正的视觉能力,能看懂屏幕上的信息。模型在衡量龙虾Agent任务执行质量的PinchBench、ClawEval和ZClawBench上取得优异成绩,验证了其在复杂任务执行场景中的综合能力。典型场景展示中,GLM-5V-Turbo能够实现图像即代码前端复刻、GUI自主探索复刻以及交互式编辑,为龙虾安上眼睛,大幅拓宽了任务边界。

相关内容

热门资讯

星海图再获20亿融资,打造通用...

近日,具身智能公司星海图宣布完成近20亿元B+轮融资。继2026年2月B轮融资后,星海图再获资本青睐...

魅族PANDAER发布车规级电...

昨日,魅族PANDAER推出了专为领克Z10STARBUFF车型设计的STARBUFF车规级电竞装备...

smart精灵#6EHD全球首...

4月1日,smart品牌在北京车展品牌之夜上展示了其最新车型——smart精灵#6EHD超级电混和s...

OpenAI遇冷,投资者转投A...

近日,OpenAI在二级市场上的吸引力出现下降,投资者开始转向其竞争对手Anthropic。Next...

智谱发布GLM-5V-Turb...

今日,智谱推出了一款名为GLM-5V-Turbo的多模态Coding基座模型,专为视觉编程设计。该模...

Anthropic误删GitH...

今日,Anthropic公司在处理ClaudeCode源代码泄露事件时发生了重大失误。公司在周二意外...

2026新势力销量榜:零跑首破...

4月2日,2026年3月造车新势力品牌销量榜发布,榜单排名出现新变化。零跑汽车以50029辆的销量成...

北京亦庄机器人挑战赛即将开赛,...

日前,2026机器人勇士挑战赛场地搭建工作已全部完成,赛事场地位于南海子公园熏风园(原二期),并已对...

粤超广州队亮剑 主帅曾发掘国脚...

粤BA激战正酣,粤超烽烟渐起!21城球队已完成集结,厉兵秣马,进入备战最后的冲刺阶段。据悉,粤超首轮...

2026广州读书月启幕 近千场...

羊城书展首次纳入读书月羊城晚报讯 记者熊安娜报道:4月1日,2026广州读书月在广州购书中心正式启动...