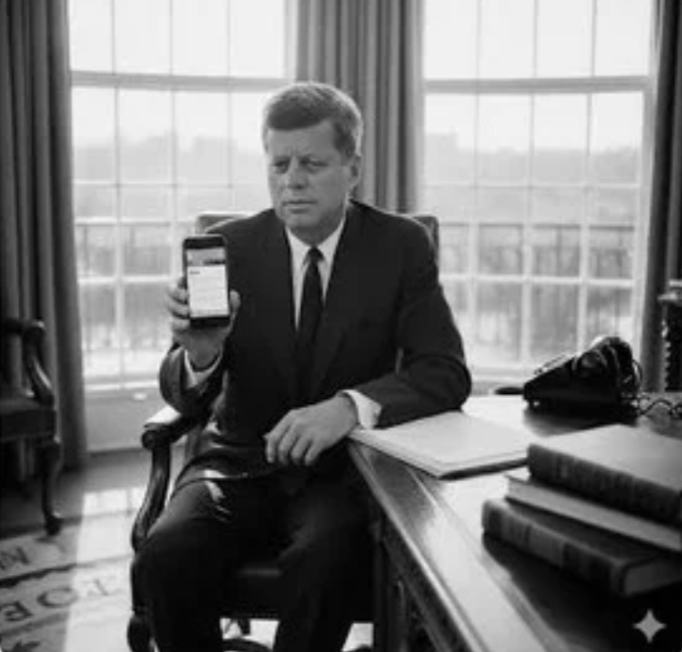

AI视频真假难辨:超半数美国人呼吁明确标签标识

创始人

2026-02-18 16:27:58

0次

2月18日,CNET的调查揭示了公众在社交媒体上识别AI生成内容的挑战。调查显示,94%的美国成年人曾在社交平台上看到过AI生成的图片或视频,但仅有44%的人认为自己能够准确区分真实内容与AI作品。在识别手段上,60%的受访者依赖于观察画面细节,25%的人通过反向图片搜索核查来源,5%的人使用深度伪造检测工具,而3%的人选择默认怀疑。

面对真假难辨的内容,51%的受访者建议对AI内容进行更明确的标签标识,21%的人主张在社交媒体上全面禁止AI生成的图片和视频。只有11%的受访者认为AI视频具有信息价值、实用性或娱乐性。调查还发现,72%的美国成年人会采取措施判断视频真伪,但部分群体,尤其是1946年至1964年间出生的人(36%)和1960年代中期至1980年代出生的人(29%),并不会主动验证,这使得虚假内容更容易被误信。

随着AI生成模型能力的提升,公众对内容真实性的判断面临前所未有的挑战。过去用于识别AI生成图像的小技巧,如看手指数量等,已逐渐失效,平台治理AI虚假内容的重要性愈发凸显。

相关内容

热门资讯

特斯拉Robotaxi夜间无人...

5月5日,特斯拉在奥斯汀的Robotaxi服务实现了新的里程碑,首次在晚间开启无人监管运营模式,打破...

嘉兴移动充电站“五一”高效服务...

5月4日,全国高速公路在“五一”假期期间车流量激增,浙江嘉兴地区通过在服务区等地点部署移动充电设备,...

日产全固态电池突破:充电快、续...

近日,日产汽车在横滨工厂的试产线上完成了车用全固态电池原型测试。这一原型样品由23层电芯组成,其充放...

领克10量产车下线!最高续航8...

今日,领克汽车销售公司宣布领克10首台量产车正式下线。领克10推出三款配置,分别为701长续航版20...

“女司机炫耀自动驾驶双手离盘,...

近日,浙江温州高速交警接到举报,一名驾驶人在社交平台发布驾驶时双手脱离方向盘的视频。视频中,该驾驶人...

女司机高速上化妆跳舞,交警:辅...

近日,浙江温州高速交警接到群众举报,称一名女子在社交平台发布多条危险驾驶视频。视频中,该女子在高速公...

领克10量产车下线,预售价20...

5月5日,领克汽车销售公司常务副总经理周钘宣布,领克品牌的10首台量产车正式下线。这款新车在2026...

Meta收购AI机器人公司AR...

Meta于5月1日完成了对物理AI模型初创企业AssuredRobot Intelligence(A...

OpenAI加速AI Agen...

IT之家5月5日消息,天风国际分析师郭明錤更新产业调查报告,透露OpenAI可能正在加速开发首款AI...

大众汽车面临碳排放罚款压力,电...

5月5日,大众汽车集团面临欧盟电动化转型压力,需销售更多电动汽车以减少碳排放,避免巨额罚款。然而,电...