苹果揭秘AI智能体用户交互新发现:透明度与信任成关键

创始人

2026-02-13 09:37:14

0次

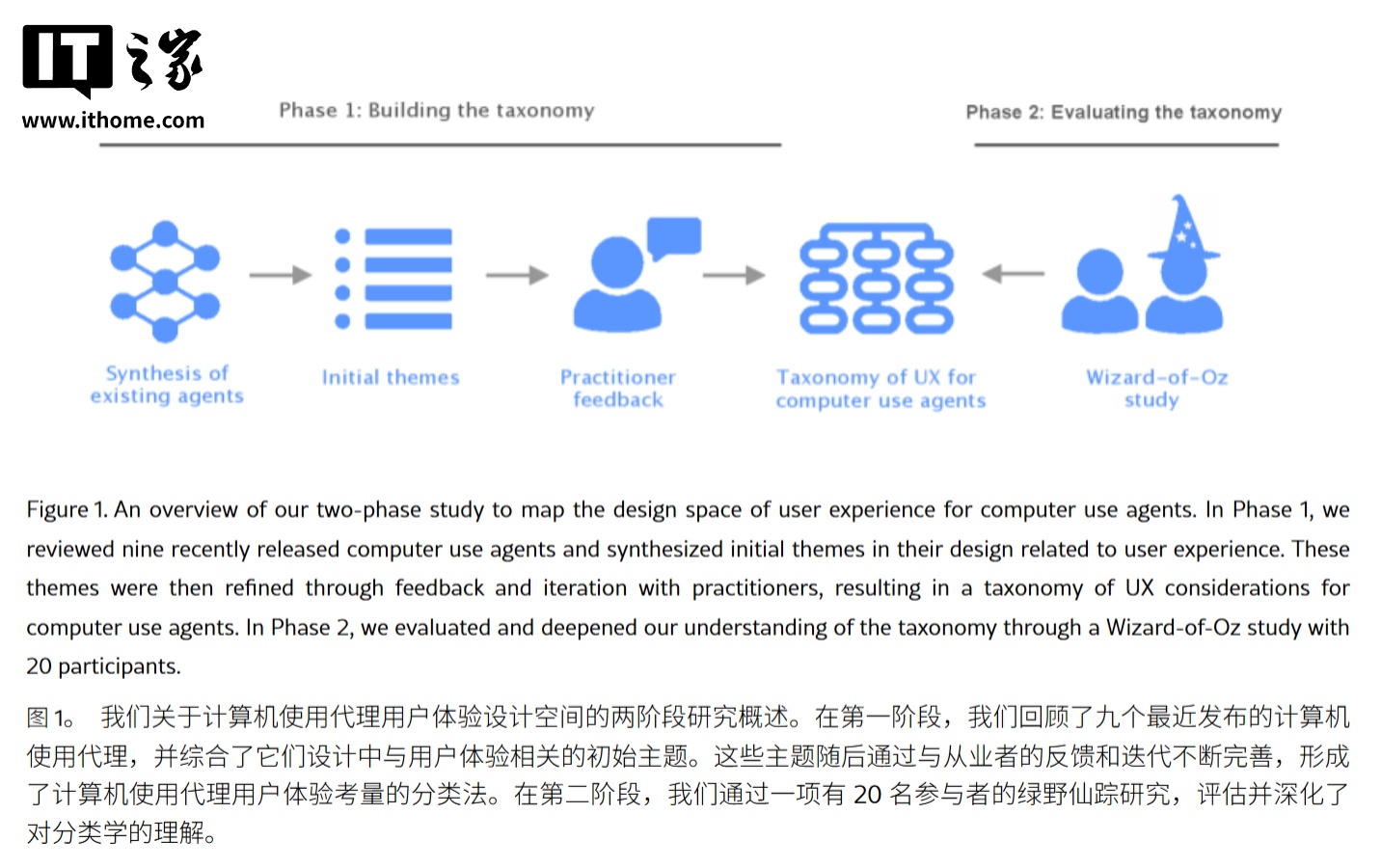

2月13日,苹果机器学习研究团队发布了一篇名为《绘制计算机操作智能体用户体验设计空间》的论文,探讨了用户对AI智能体的期望和交互偏好。研究指出,尽管市场对AI智能体的投资不断增加,但界面形态和交互逻辑的探索仍不够充分。为此,苹果团队分析了9款主流AI智能体产品,并进行了实地用户测试,以明确设计规范。

研究的第一阶段,苹果团队深入分析了包括ClaudeComputerUse、OpenAIOperator及AutoGLM在内的9款AI智能体,并构建了一个包含“用户指令”、“活动可解释性”、“用户控制”及“心智模型”四大维度的分类体系。这个体系覆盖了用户如何下达命令,以及AI如何展示操作计划、报错和移交控制权的全过程。

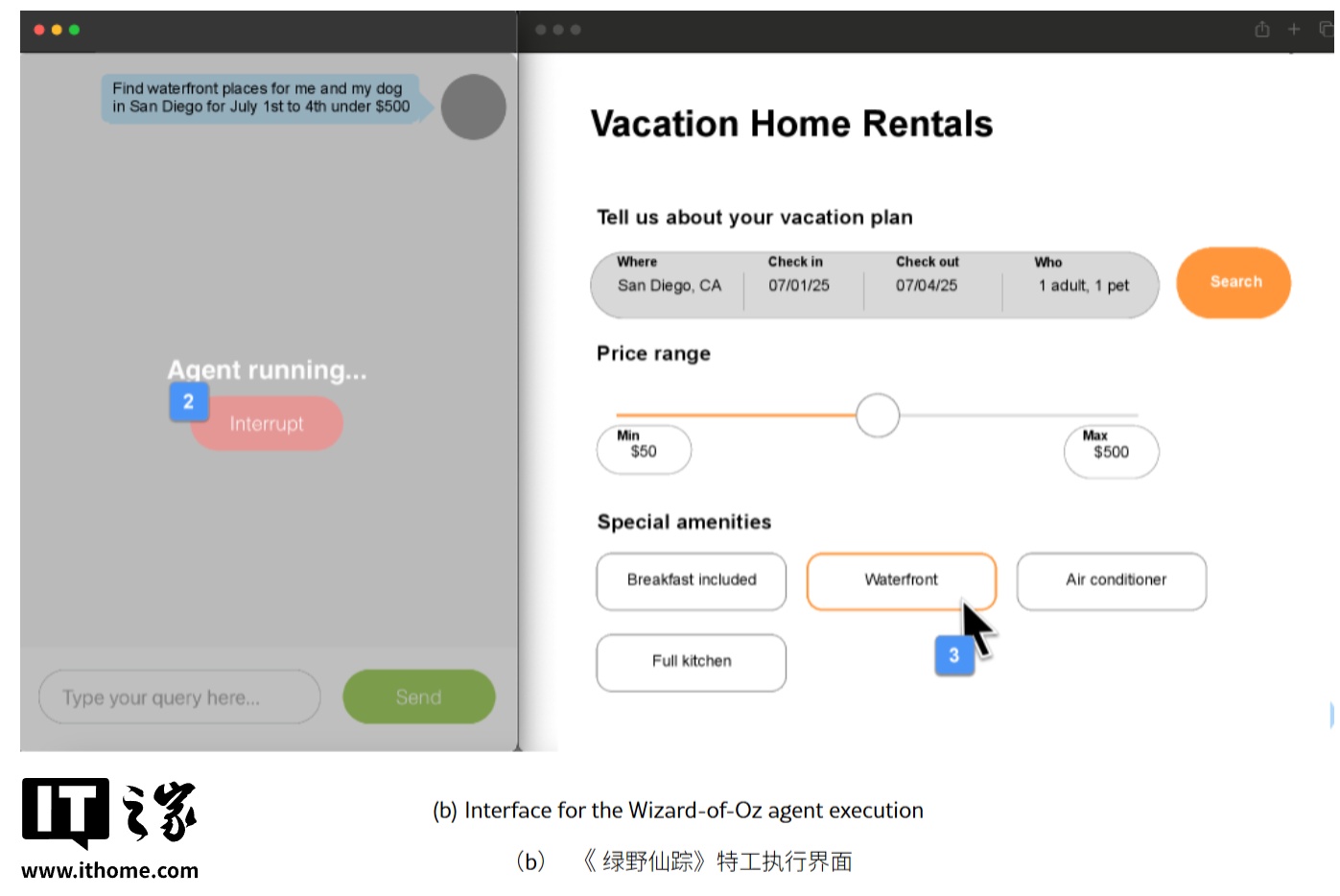

在第二阶段,苹果采用了“绿野仙踪法”进行实验,招募了20名有AI使用经验的用户,通过聊天界面完成度假租赁或在线购物任务。实验中,真人模拟AI操作,包括故意犯错或陷入死循环,以捕捉用户在面对AI决策时的真实心理反应与行为模式。结果显示,用户对AI的透明度有微妙需求,他们希望了解AI的动向,但不愿微观管理每个步骤。这种需求随场景变化,探索性或不熟悉的任务中,用户希望看到更多中间步骤与解释;而在高风险场景中,用户要求有绝对的确认权。研究强调,信任是人机交互的基石,但极其脆弱,AI智能体在遇到模糊选项时未询问便擅自做主,或在未告知的情况下偏离原定计划,会迅速破坏用户的信任感。

相关内容

热门资讯

丰田130亿建印度三厂,目标年...

5月6日,丰田汽车宣布在印度西部马哈拉施特拉邦投资约3000亿日元(约合130亿元人民币)新建三座整...

Rivian拟自产激光雷达,C...

近日,美国电动汽车制造商Rivian的CEO RJ·斯卡林奇透露,公司正在考虑自行生产激光雷达传感器...

华为鸿蒙系统升级:小艺帮记新增...

5月6日,华为鸿蒙HarmonyOS 6.1系统对“小艺帮记”功能进行了更新,新增身份验证和同步收藏...

疲劳驾驶酿大祸!男子信辅助驾驶...

5月5日,杭甬高速宁波方向发生一起因驾驶员过度信任辅助驾驶系统而引发的违规停车事件。一辆黑色SUV在...

小米SU7销量破8万!限时权益...

5月6日,小米汽车宣布新一代SU7上市48天以来,锁单量已突破8万台。为庆祝这一成绩,小米汽车推出限...

F1将迎V8引擎回归,2030...

5月6日,国际汽联(FIA)主席穆罕默德·本·苏拉耶姆在迈阿密大奖赛期间宣布,F1计划在2030年左...

Meta被控盗用百万作品训练A...

5月5日,多家出版商联合起诉Meta Platforms,指控其非法使用受版权保护的书籍和期刊文章来...

中国联通车联网卡落地1亿辆汽车...

5月6日,中国联通宣布搭载其车联网卡的第1亿辆汽车正式落地,标志着我国建成全球规模最大的车联网连接基...

岚图董事长卢放:新能源车需创新...

5月6日,岚图汽车科技股份有限公司董事长卢放发表文章,探讨了品牌历史与未来的关系。卢放指出,在各地车...

华为ADS5领航辅助驾驶:10...

5月6日,华为公司高级副总裁、引望公司CEO靳玉志分享了自己使用华为乾崑智驾ADS5的出行体验。他从...